Cambridge sözlüğü ‘yılın kelimesi’ni açıkladı: Artık yeni bir anlamı var!

Bu yıl ChatGPT gibi yapay zeka araçlarına ilginin arttığı görüldü. Erişilebilir chatbot, İngiliz bir yargıç tarafından mahkeme kararının bir kısmını yazmak için bile kullanıldı; bir yazar ise Sky News’e bunun romanlarında kendisine nasıl yardımcı olduğunu anlattı. Ancak her zaman güvenilir ve doğruluğu kontrol edilmiş makaleler sunmaz.

YILIN KELİMESİ: “HALÜSİNASYON”

“Halüsinasyon”Kelimenin klasik tanımı, genellikle sağlık durumu veya uyuşturucu kullanımı nedeniyle kişinin var olmayan bir şeyi hissediyormuş gibi görünmesidir ancak bu terim artık yapay zekanın yanlış bilgi üretmesiyle de ilişkilendirilmektedir.

Konfabulasyon olarak da bilinen AI halüsinasyonları araçların yanlış bilgi sağladığı durumlar; Bu bilgiler görünüşte son derece makul tekliflerden düpedüz saçma olanlara kadar değişebilir.

Cambridge Dictionary’nin yayın direktörü Wendalyn Nichols şunları söyledi: ” Yapay zekanın ‘halüsinasyon’ görebilmesi gerçeği bize, insanların bu araçları kullanırken hâlâ eleştirel düşünme becerilerini sergilemeleri gerektiğini hatırlatıyor.

Yapay zekalar, belirli bilgileri çıkarmak ve birleştirmek için büyük miktarda bilgiyi yayma konusunda mükemmeldir. Ama onlardan orijinal olmalarını ne kadar çok isterseniz, yoldan çıkma olasılıkları da o kadar artar.”söz konusu.

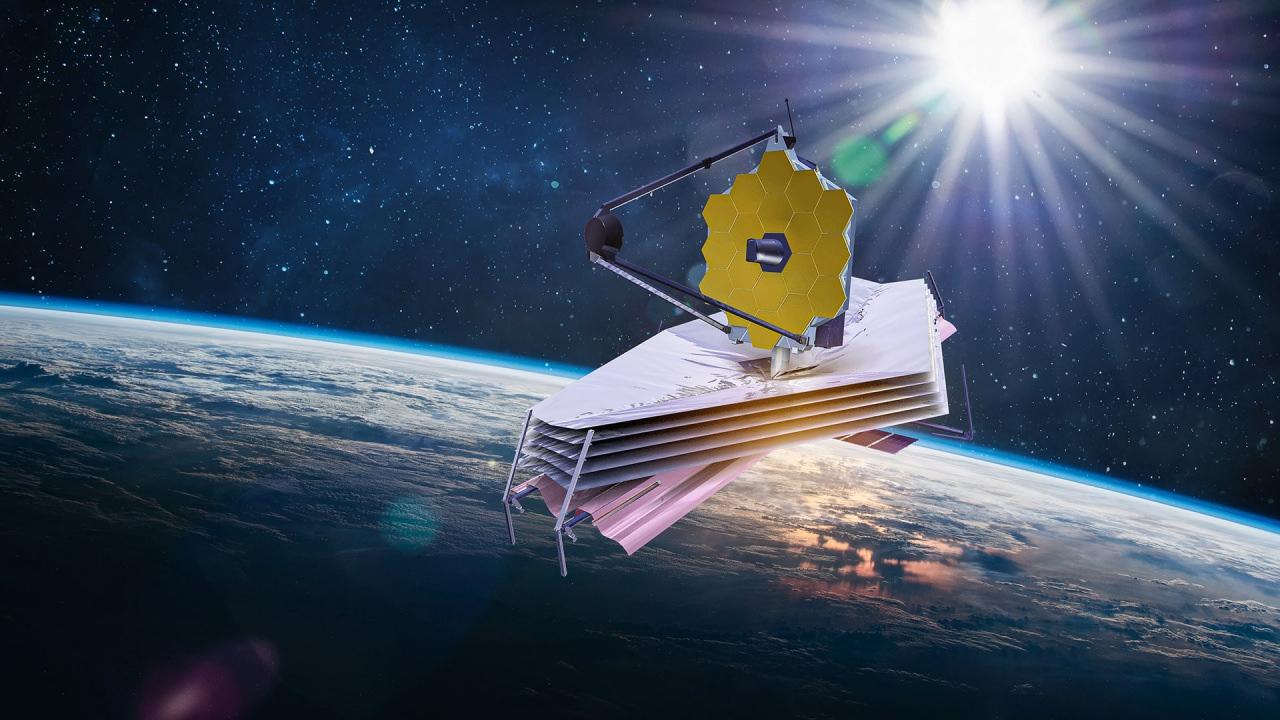

YAPAY ZEKA JAMES WEBB UZAY TELESKOP HAKKINDA YALAN SÖYLEDİ

Büyük dil modellerini (LLM’ler) kullanan yapay zeka araçları “Ancak eğitim bilgileri kadar güvenli olabilir”Ekledi: “LLM’lerin eğitilebileceği güvenilir ve güncel bilgiler yaratmak için insan uzmanlığının her zamankinden daha önemli ve aranan bir konu olduğu tartışmasız.”

Yapay zeka kendinden emin ve ikna edici bir şekilde halüsinasyon görebilir ve bunun gerçek dünyada da etkileri olmuştur.

ABD’li bir hukuk firması, hukuki araştırma için ChatGPT’yi kullandıktan sonra mahkemede hayali davalara atıfta bulunurken, Google’ın yapay zeka sohbet robotu Bard’ın tanıtım görseli, James Webb Uzay Teleskobu hakkında gerçeklere dayalı bir sahtekarlık yaptı.

‘ALGIDA DERİN BİR DEĞİŞİM’

Cambridge Üniversitesi’nden yapay zeka etik uzmanı Dr. Henry Shevlin şunları söyledi: “ChatGPT gibi sistemlerdeki hatalara atıfta bulunmak için ‘halüsinasyon’ teriminin yaygın kullanımı, yapay zekayı nasıl insanlaştırdığımıza dair büyüleyici bir anlık görüntü sunuyor.”

“‘Halüsinasyon’, bir failin gerçeklikten kopma yaşadığını ima eden çağrışımsal bir fiildir.”o devam etti. “Bu dil seçimi, algıdaki ince ama derin bir değişimi yansıtıyor: ‘Halüsinasyon gören’ kullanıcı değil, yapay zekadır.

Bu, yapay zekanın bilinçli olduğuna dair yaygın bir inanışa işaret etmese de, yapay zekaya insani nitelikler atfetmeye hazır olduğumuzun altını çiziyor.

“Bu on yıl ilerledikçe, ruhsal kelime dağarcığımızın, yarattığımız yeni zekaların tuhaf yeteneklerini de içerecek şekilde daha da genişleyeceğini umuyorum.”